極速上手,告別複雜

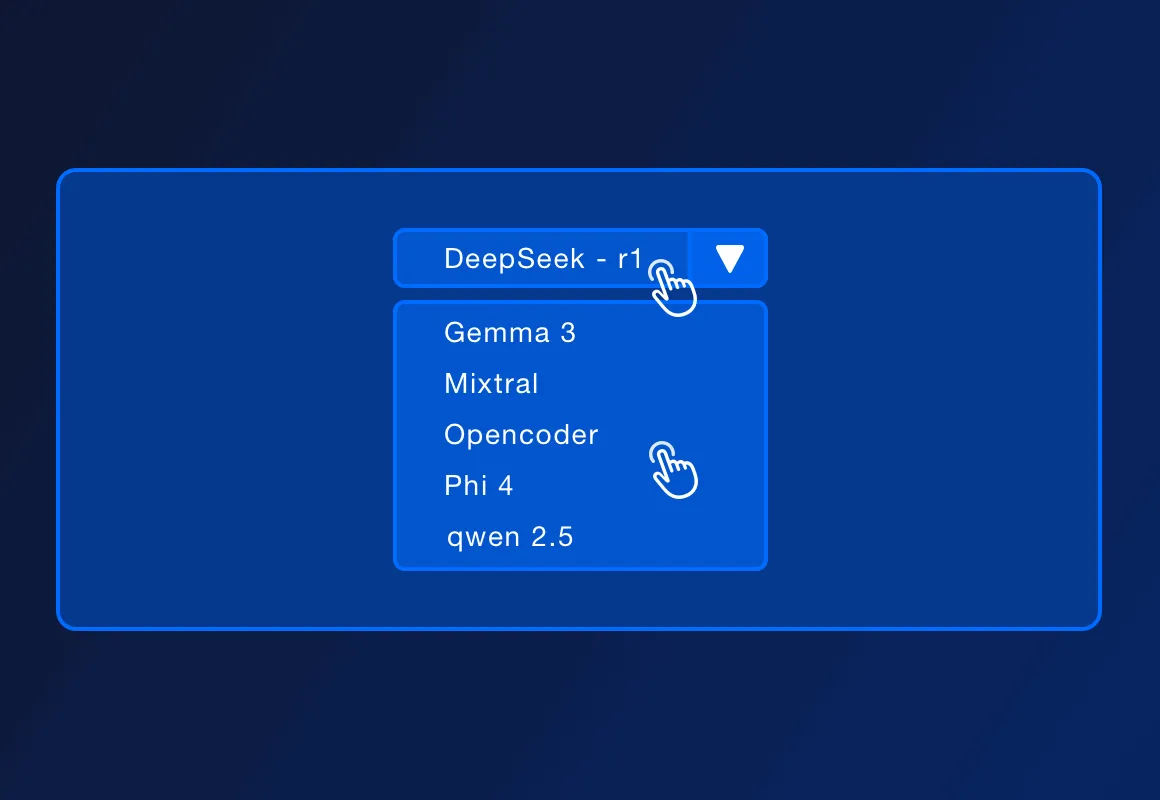

當傳統Ollama部署還在讓開發者手動配置環境變量、下載模型文件時,ServBay已實現「勾選即安裝」。無論是1.5B輕量級模型還是671B專業級模型,只需在圖形化界面中選擇版本,點擊安裝即可自動完成依賴部署與資源分配,徹底告別命令行報錯的煩惱。技術小白也能快速駕馭。

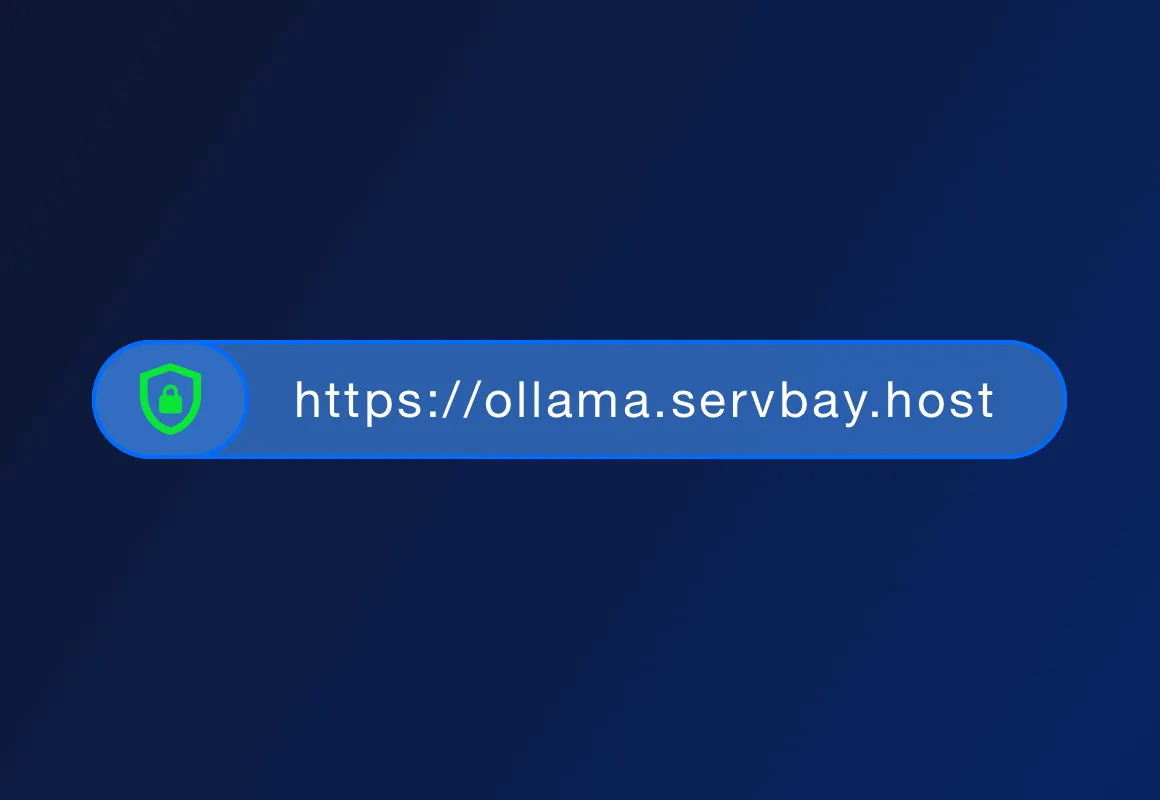

ServBay的主要優勢在於一鍵安裝LLM、本地運行、數據隱私、離線可用、成本較低。與雲端LLM服務相比,ServBay不需要網絡連接,數據保留在本地,不用擔心隱私洩露。

ServBay支持多種流行的開源LLM,例如DeepSeek - r1、Llama 3.3、Mistral、Code Llama等。具體支持的模型列表可能會隨著官方的更新而增加。

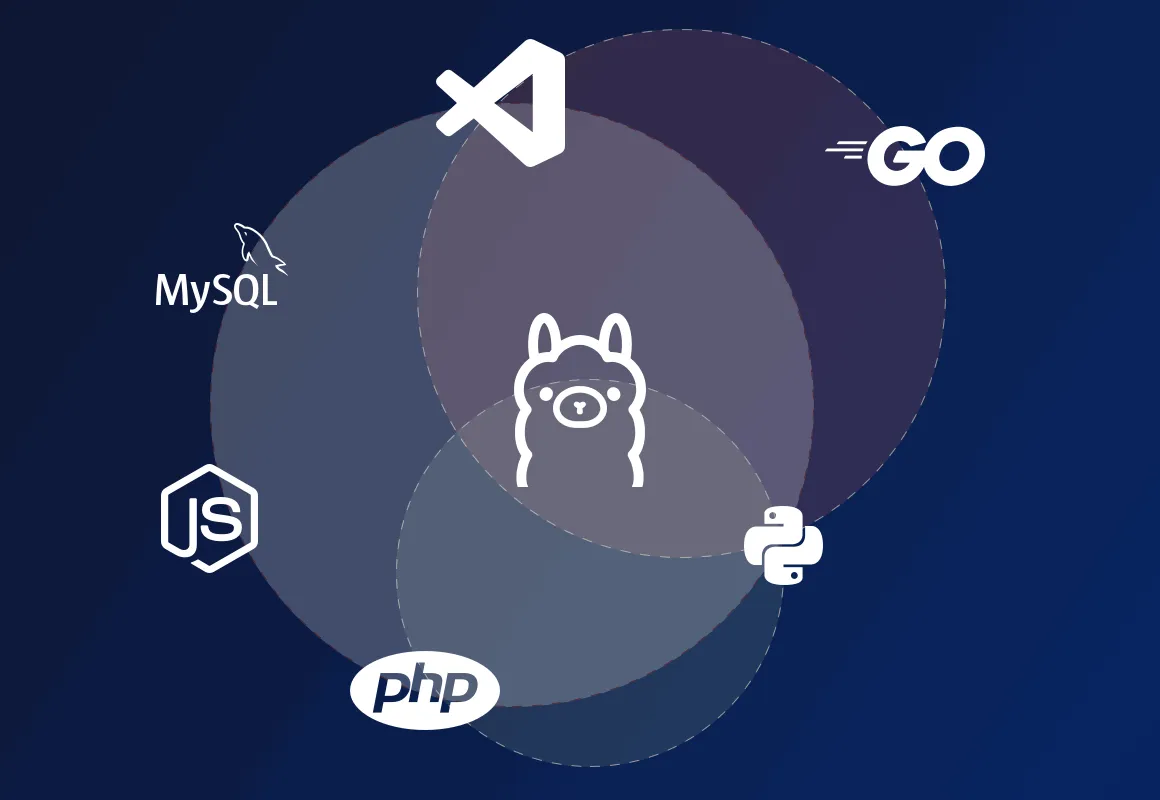

ServBay支持PHP、Python、Node.js、Go等本地開發環境部署,結合Ollama一起,適合本地開發、原型設計、學習和個人使用。在需要高並發、高可用性和複雜管理功能的生產環境中,ServBay也能提供更專業的部署方案。

ServBay自身就是開發環境管理平台,提供PHP、Python、Node.js和Go等語言的開發環境部署,並且還提供各種數據庫和伺服器支持。現在ServBay更是支持一鍵安裝Ollama,開發者可以通過Ollama提供的REST API與本地運行的模型進行交互,發送文本輸入並接收模型輸出,由此可以在本地構建各種AI驅動的應用和服務。